Call of Duty: Black Ops 6 no trae innovadores cambios en la trilogía de modos de juegos que ya hemos visto siempre. Un modo campaña que busca tener un pequeño lugar en nuestro corazón además de un multijugador y un modo zombies que para agradar a la comunidad nos llevaron a lo que a todos les agrado siempre.

La campaña de mercadeo de este juego ha sido y sigue siendo agresiva, trayendo las cosas por las que la franquicia se caracterizó en un entonces y hoy en día Activision nos quieren dejar saber que no se han olvidado de eso en lo absoluto. Modern Warfare (2019) ha sido el mejor ejemplo de entregarnos algo nuevo y fresco volviendo a los inicios. No voy a dejar de mencionar esta entrega porque la realidad es que cambió la forma en la que jugamos Call of Duty en general.

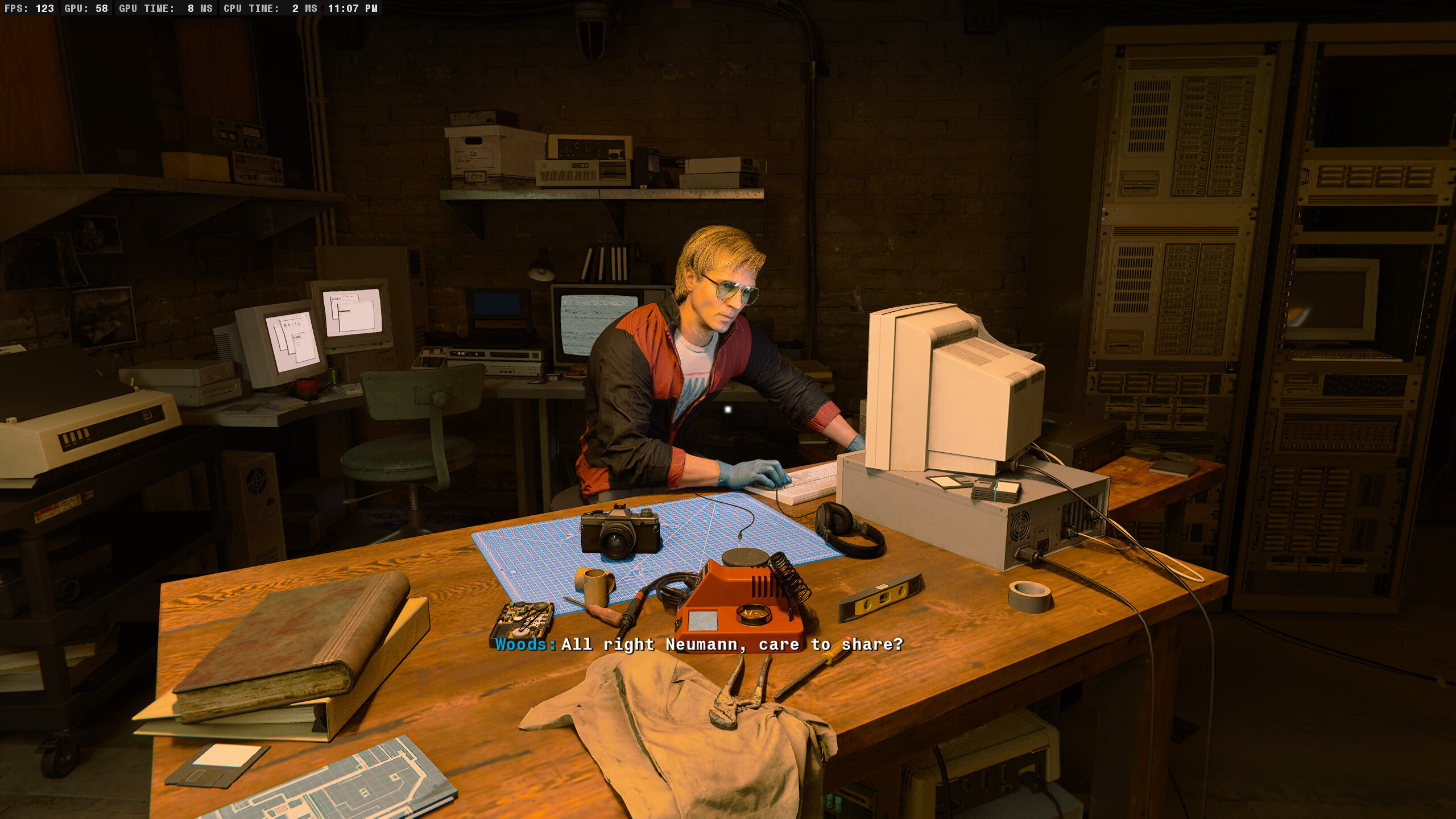

Black Ops Cold War fue el vivo ejemplo de que estas franquicias viven en dos mundos diferentes y desde el primer Black Ops para mi siempre tuvo su plato aparte aunque entrega tras entrega fui perdiendo el interés totalmente. Si iniciamos por lo primero que todos estamos acostumbrados a jugar en un lanzamiento tenemos la campana. Probablemente para esta fecha ya habrán leído lo asombrosa que puede ser pero yo vi algo que quizás otros no y es que se siente como si estuvieras en una serie de TV más que en una película, a lo que eso me preocupa.

Todo parece indicar que la nueva meta de todo esto es entregarnos la calidad baja de serie de televisión a una obra cinematográfica. La trilogía de Modern Warfare, tanto la clásica como la nueva tenía algo que las otras no tenían y es el nivel de detalle, narrativa e incluso actuación que nos hace sumergirnos bastante. Sacando de un lado la campaña de Modern Warfare III, la parte cinemática estuvo muy bien dirigida, tanto así que me he atrevido a volver a jugar esas campañas anteriores para recordarme de lo que sí es bueno.

Es bueno ver caras nuevas, es bueno ver muchos cameos pero esto es como una serie de Netflix, empiezas bien y el muñeco está bien diseñado pero el producto final/desenlace termina dejándonos con un sabor de boca incómodo, que si realmente muchos entenderán, una vez terminas la campana te deberías de quedar con las ganas de ir al multijugador a continuar lo que ya estabas haciendo.

Recuerdo como el juego mismo nos decía que había más cosas por hacer y armas que probar, a lo que nos veríamos obligados a ir al multijugador a probar nuestra habilidad. Esto realmente es lo que un Call of Duty debería de hacer, dejando de un lado a los que realmente no quieren llevar la tradición de esta forma, si primero visitamos el multijugador nos daremos cuenta que no será más de ahí. Simplemente la competitividad en este modo está dividida y eso me preocupa bastante porque están los que intentamos jugar luego de un largo día de trabajo y luego están los que ya están en el prestigio más alto posible ya que solo juegan eso.

Venir a encontrarnos con unos cambios bastante buenos y tener que aprendernos una nueva forma de jugar es tedioso. El nuevo Omnimovement no es para nada malo y no estoy en contra del cambio pero si estoy en contra de hacer algo que para aprenderlo necesitemos una enorme curva de aprendizaje y que a la larga beneficie más al que tiene más tiempo para jugar. Ahora solo veo personas en el suelo y escondiéndose en una esquina con este movimiento poco competitivo, la verdad hay que decirla.

Si el juego tiene nuevas, si el juego tiene una excelente manera de jugar con perks y funciones mejoradas pero termina siendo el mismo sistema de todos los anteriores. Buscar la mejor arma y terminar en el mismo círculo vicioso una y otra vez sin dejar de lado que este nuevo movimiento vuelve el juego de lo más tedioso y poco probable aprendas todo de una vez si solo le dedicas varias horas a la semana.

Muchos pensaran que es una queja de un jugador casual pero el juego está hecho para todo tipo de público o de lo contrario no fuese la franquicia que más ventas ha tenido a lo largo de su historia. El objetivo del juego es hacerlo entretenido pero eso se quedó atrás y recuerdo cuando se incluyeron los trajes Exo, correr por las paredes saltando en Black Ops 4. Ese efecto futurista arruinó por completo la franquicia y lo mismo sucede con esta entrega, algo que no era necesario fue incluido de una forma abrupta.

La realidad de todo esto es que si quitamos ese nuevo movimiento, Black Ops 6 es simplemente Cold War con gráficos mejorados (y armas más modernas). Este no mejora en un nivel tan profundo y realmente inquieta ver como el nivel de creatividad de estos estudios disminuye con el tiempo además de que la obsesión de Microsoft demostrar que su nueva franquicia va vender mucho ha llevado el juego a prostituirse en el mismo Game Pass, trayendo jugadores que no son fieles a la franquicia a jugarlo ya que es parte del servicio.

Llevar el modo zombies a lo clásico por oleadas es una movida bastante buena pero al mismo tiempo es el desespere de la compañía por contentar a todos luego de pasar malos momentos. El objetivo de este modo sobre todo es el disfrute, jugar con amigos o en línea es algo que realmente siempre nos ha llenado de mucho placer a nosotros los gamers pero al mismo tiempo debemos entender que los zombies no son eternos y que su repetitividad es bastante limitada.

Estos zombies son divertidos pero hasta cierto punto, luego de varios intentos de rondas extensas uno se cansa de intentar las cosas tantas veces. A diferencia de las otras entregas, el modo zombies ha pasado por una gran cantidad de cambios y evoluciones. Todo esto se resume a la inclusión de más zonas de exploración, easter eggs que realizar pero sobre todo nuevos que completar. El modo zombies el Spec Ops que Black Ops y personalmente lo veo como un modo entretenido que la creatividad hace que nos sintamos cansados de él con el tiempo.

En la parte del rendimiento, este review fue realizado en una PC con las siguientes especificaciones:

- Procesador: AMD Ryzen 7 7800X3D

- Motherboard: ROG CROSSHAIR X870E HERO (DDR5)

- RAM: GSkill Trident Z5 RGB 2x16GB DDR5-6400 con AMD Expo

- Case: be quiet! Light Base 600 LX

- GPU: ASUS TUF Radeon RX 7700 XT OC Edition

- Monitor: AOC AGON PRO QD-OLED AG276QZD2

- SSD: Corsair MP600 PRO NH de 2TB

- SSD 2: FireCuda 540 PCIe Gen5 NVMe 2TB

- PSU: Be Quiet! Pure Power 12 M Fully-modular

- Sistema Operativo: Windows 11 (Ultima versión)

Black Ops 6 tiene una alianza estratégica con AMD y como lo vimos en el mismo Cold War, algunas cosas de rendimiento son dignas de admirar cuando el desarrollador se une a una de las compañías creadoras de tarjetas gráficas. El juego corre bastante bien con los gráficos en Ultra (no en Extremo) y para la tarjeta de video RX 7700 XT este es todo un reto ya que el nivel gráfico que buscamos alcanzar tiene mucho que desear. El juego se ve bastante bien pero especialmente en el modo campaña donde las escenas, los disparos e incluso los efectos como el fuego tienen un buen nivel de detalle.

Por encima de todo el juego se siente fluido en todos los modos, sin dejar nada atrás no sientes esos saltos que se sentían en otras entregas tempranas. Personalmente sufrí mucho con Cold War una RX 6700 XT que tuve, asi que pienso que una cosa si se hizo bien y fue la de optimizar el juego para que sea jugable con gráficos decentes y obviamente siempre es bueno recordar que si tenemos mejores FPS, las partidas serían bastante diferentes.

En conclusion

Superar entregas anteriores es difícil pero tratar de reivindicar una es otra cosa, Activision ha puesto toda sus fuerzas para que Call of Duty: Black Ops 6 nos regrese a esos años dorados donde todo era épico pero nos terminan dando un juego con una campaña aceptable, un multijugador que quedará en el olvido pronto y unos zombies que hacen muy aburrida su repetitividad. Esta nueva entrega combina muchas cosas de nostalgia que a muchos de nosotros nos llenó de mucho hype pero al mismo tiempo nos desploma viendo como el mismo sistema de armas falla nuevamente, los puntos de separación son injustos además de que estos juegos nos tienen acostumbrados a encontrar el arma Meta para sacarle ventaja a todo posible.

La franquicia Call of Duty se ha convertido en un total desastre en el que hacer el mismo jeugo una y otra vez es mejor que tratar de entregarnos cosas nuevas. Modern Warfare (2019) ha sido hasta ahora lo único bueno que han “reiniciado” y me gusta quedarme con esa experiencia en la cabeza. Por encima de todo Black Ops 6 no es un mal juego, es más bien una extensa campaña de mercadeo que logró su prometido, enganchar a cuantos sea necesario para compartir unas partidas con los muchachos ya que al final, no queda mas nada que aprender a usar el Omnimovement a como dé lugar. Este review fue realizado en PC y la copia del juego es gracias a Activision.